Un investigador del Tec de Monterrey, distinguido como Google PhD Fellow 2025, trabaja en una investigación que busca llevar la inteligencia artificial (IA) a los límites de la miniaturización tecnológica: robots, sensores y sistemas embebidos que puedan aprender del entorno y tomar decisiones por sí mismos, sin depender de nubes de cómputo o centros de datos de alto consumo energético.

En un mundo donde los modelos de IA más avanzados requieren granjas de servidores, enormes cantidades de energía y entrenamientos multimillonarios, el proyecto de Luis Eduardo Garza Elizondo, un investigador de la Escuela de Ingeniería y Ciencias del Tecnológico de Monterrey (EIC), propone una alternativa radical: Tiny Reinforcement Learning (TinyRL), un paradigma que permite ejecutar algoritmos inteligentes en entornos con recursos extremadamente limitados.

“Hoy, los grandes modelos de IA están generando un impacto ambiental significativo debido a su enorme consumo de energía y recursos. Nosotros queremos demostrar que es posible crear modelos igual de eficientes pero mucho más sostenibles y accesibles”, explica el investigador.

El enfoque de TinyRL combina el aprendizaje por refuerzo, una rama de la inteligencia artificial que permite a los sistemas aprender por experiencia, con métodos matemáticos avanzados como los derivados del teorema de Kolmogorov-Arnold. Este enfoque permite que los algoritmos aprendan directamente en dispositivos embebidos, optimizando su memoria, procesamiento y consumo energético: algoritmos capaces de aprender y adaptarse en dispositivos tan pequeños como un microcontrolador.

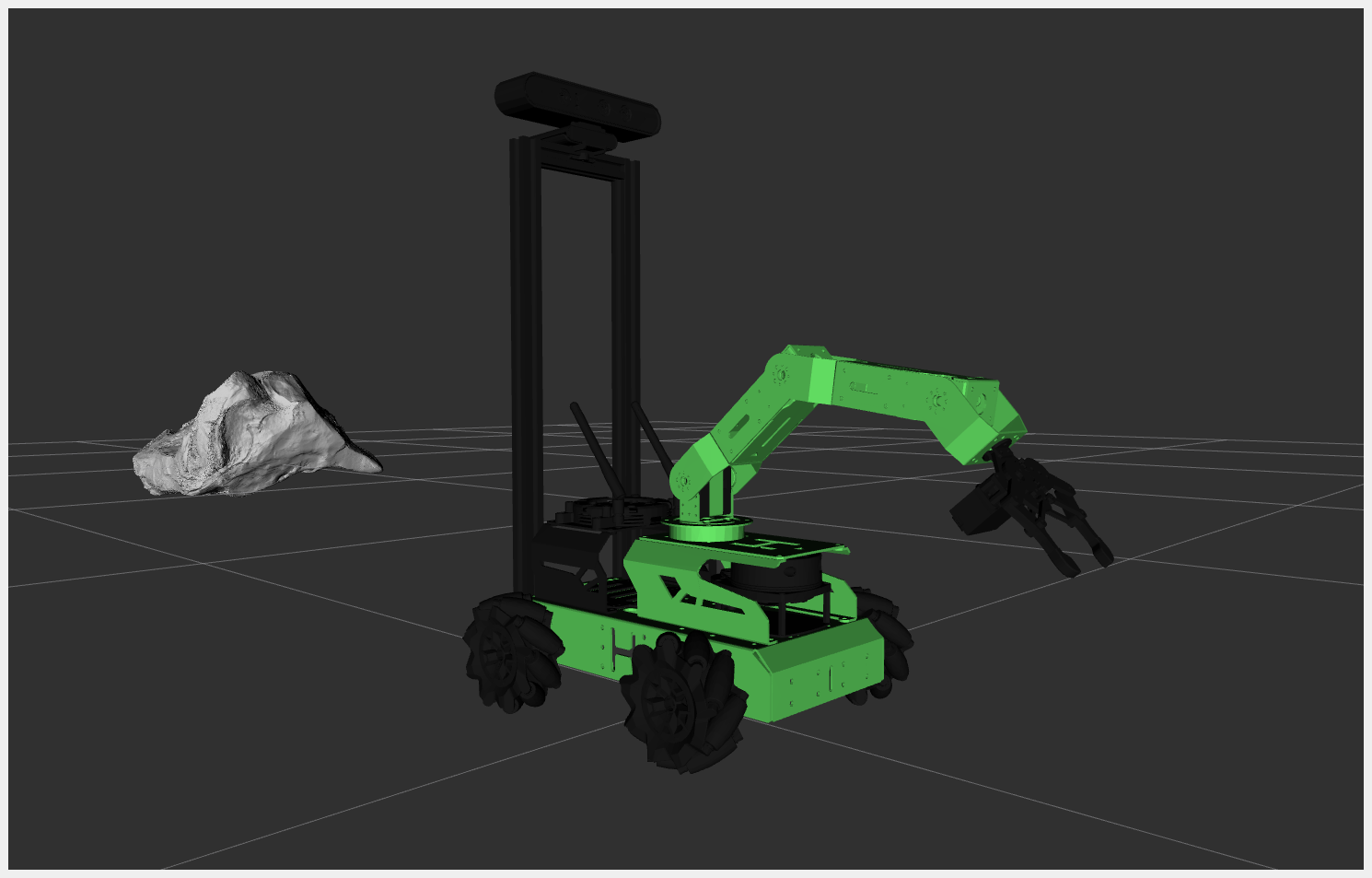

Garza Elizondo forma parte de un equipo de investigadores del Tec de Monterrey que trabajan actualmente en un robot terrestre que aprende a moverse y adaptarse a obstáculos sin tener conocimiento previo de su entorno: “Partimos de un robot que no sabe nada: no conoce sus sensores ni sus actuadores. Lo que hacemos es permitirle descubrir, a través de ensayo y error, cómo desplazarse, cómo sortear obstáculos, cómo llegar a un objetivo. Con el tiempo, el robot va aprendiendo por sí mismo y alcanza un desempeño óptimo”, explica.

Las simulaciones iniciales realizadas con agentes de aprendizaje por refuerzo muestran cómo el robot mejora progresivamente su desempeño, pasando de comportamientos erráticos a movimientos eficientes después de pocas horas de entrenamiento. En etapas futuras, el equipo implementará estos algoritmos en hardware real, con arquitecturas multi-microcontrolador que permitirán la colaboración de múltiples agentes en tareas compartidas.

El proyecto forma parte del núcleo estratégico de Industria 5.0 del Tec de Monterrey, que impulsa la creación de tecnologías centradas en el ser humano y en la sostenibilidad. A través de la convergencia entre inteligencia artificial, robótica y diseño de hardware, esta línea busca tecnologías más intuitivas, seguras y conscientes del entorno.

“Una de las innovaciones que estamos desarrollando es un enfoque poblacional: varios robots trabajando juntos para aprender más rápido y compartir conocimiento. Esto podría ser clave para optimizar procesos industriales, sistemas autónomos o incluso dispositivos médicos inteligentes”, comenta.

Las posibles aplicaciones de esta tecnología son amplias. Desde robots industriales más seguros y adaptables, hasta dispositivos portátiles de salud capaces de anticipar anomalías fisiológicas. “Imagina un reloj inteligente que no solo mide tu frecuencia cardíaca o tus pasos, sino que pueda anticipar tendencias y alertarte sobre cambios significativos en tu salud antes de que ocurran. O robots de asistencia que puedan adaptarse a cualquier hogar, sin importar las condiciones del entorno”, apunta el investigador.

Con el proyecto “Tiny Reinforcement Learning for Microcontroller-based Embedded Systems”, Garza Elizondo fue seleccionado como Google PhD Fellow 2025, un reconocimiento internacional que distingue a jóvenes científicos cuyas investigaciones están transformando el futuro de la computación.

Fuentes: